Nhìn vào điện thoại người lạ vài giây, người phụ nữ hốt hoảng khi tối về nhận thông báo đang vay 1,7 tỷ

Điện thoại vẫn nằm trong tay, nhưng quyền kiểm soát đã thuộc về người khác.

Ngày 26 tháng 12 năm 2025, tạp chí Phụ Nữ Mới đăng tải bài viết với tiêu đề "Nhìn vào điện thoại người lạ vài giây, người phụ nữ hốt hoảng khi tối về nhận thông báo đang vay 1,7 tỷ". Nội dung như sau:

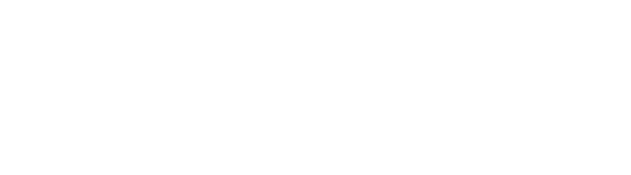

Một vụ lừa đảo chấn động tại Hàng Châu (Trung Quốc) đã gióng lên hồi chuông cảnh báo về sự nguy hiểm của công nghệ AI. Nạn nhân là một người mẹ trẻ đang đưa con đi dạo tại trung tâm thương mại thì một người lạ mặt tiếp cận với vẻ mặt hớt hải.

Kẻ này đưa ra một kịch bản rất đáng thương: "Điện thoại em gặp sự cố, em cần quay một đoạn video gửi cho người nhà để làm bằng chứng chuyển tiền gấp. Chị làm ơn đứng trước camera máy em, đọc hộ em số tài khoản của chị để người nhà em tin là thật."

Vì nghĩ rằng mình không hề đưa điện thoại cá nhân cho người lạ, cũng không nhấn vào đường link hay cung cấp mật khẩu nào nên người phụ nữ đã đồng ý giúp đỡ. Cô nhìn thẳng vào camera máy của kẻ lạ mặt, đọc to dãy số và thực hiện các động tác chớp mắt, há miệng theo hướng dẫn của hắn để “lấy nét cho rõ”.

Kết quả là chỉ vài giờ sau, điện thoại cô liên tục báo tin nhắn về 6 khoản vay tài chính thành công. Tổng số nợ lên đến 480.000 NDT (khoảng 1,7 tỷ VNĐ) mà cô không hề hay biết.

Tại sao "không chạm vào máy mình" vẫn mất tiền?

Nhiều người lầm tưởng rằng chỉ cần giữ chặt điện thoại cá nhân là an toàn. Tuy nhiên, trong thời đại AI, chính khuôn mặt và giọng nói của bạn mới là "chiếc chìa khóa vạn năng".

Kẻ gian thực hiện quy trình lừa đảo theo 3 bước sau.

Bước 1: Thu thập dữ liệu. Việc nhờ nạn nhân đọc dãy số trên máy của chúng thực chất là để thu âm mẫu giọng nói (Voiceprint) chất lượng cao. Việc yêu cầu nhìn vào camera, chớp mắt, há miệng là để ghi lại các cử động sinh trắc học – thứ mà các ứng dụng ngân hàng dùng để xác thực “người thật” (Liveness Detection).

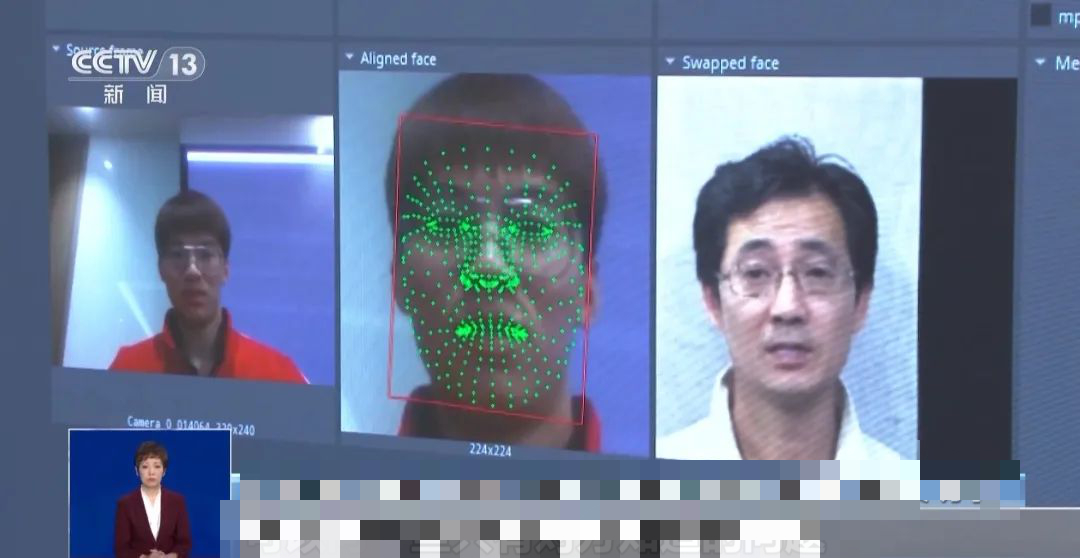

Bước 2: Chế bản "Bản sao kỹ thuật số". Sau khi có video gốc, chúng sử dụng các phần mềm Deepfake chuyên dụng để tạo ra một bản sao kỹ thuật số của nạn nhân. Bản sao này có thể nói bất cứ điều gì và thực hiện bất cứ động tác xác thực nào một cách mượt mà.

Bước 3: Vượt rào xác thực ngân hàng. Khi đăng nhập vào các ứng dụng vay tiền bằng thông tin cá nhân của nạn nhân (đã được thu thập từ trước qua các nguồn rò rỉ dữ liệu), hệ thống sẽ yêu cầu quét mặt. Thay vì đưa mặt thật, kẻ gian sử dụng các công cụ truyền hình ảnh AI trực tiếp vào luồng camera của ứng dụng. Hệ thống AI của ngân hàng bị đánh lừa hoàn toàn vì hình ảnh khớp 100% với dữ liệu sinh trắc học của nạn nhân.

Sở dĩ kẻ gian có thể thực hiện thành công bước cuối cùng là do chúng thường đã có sẵn thông tin cơ bản của nạn nhân (Số căn cước, số điện thoại) từ các chợ đen dữ liệu hoặc từ chính những thông tin bạn chia sẻ công khai trên mạng xã hội. Video quay trực tiếp tại hiện trường chỉ là “mảnh ghép cuối cùng” để chúng hoàn thiện hồ sơ vay vốn.

Lời khuyên từ chuyên gia

Chuyên gia an ninh mạng khuyến cáo người dân tuyệt đối không thực hiện các hành động mang tính chất định danh như nhìn thẳng vào camera, chớp mắt, há miệng hoặc quay đầu theo yêu cầu của người lạ. Việc bạn đứng trước ống kính của một người không quen biết và thực hiện các cử động này thực chất là đang giúp tội phạm hoàn thiện quy trình xác thực "người thật".

Bên cạnh đó, mẫu giọng nói của mỗi cá nhân, đặc biệt là khi đọc các dãy số, cũng là một tài liệu sinh trắc học vô giá đối với những kẻ lừa đảo. Bạn nên đặc biệt cảnh giác với các yêu cầu đọc to các chữ số hoặc đoạn văn bản trước máy quay của người khác, vì chúng có thể được dùng để tổng hợp thành các lệnh chuyển tiền bằng giọng nói. Thay vì chỉ phụ thuộc vào các hình thức xác thực sinh trắc học vốn có thể bị giả mạo bởi AI, người dùng nên chủ động thiết lập thêm nhiều lớp bảo mật khác.

Cuối cùng, sự tỉnh táo trong việc chia sẻ thông tin cá nhân trên mạng xã hội cũng đóng vai trò then chốt trong việc ngăn chặn các vụ lừa đảo này từ sớm. Khi nhận thấy bản thân đã lỡ cung cấp hình ảnh hoặc giọng nói cho người lạ trong những tình huống nghi vấn, việc đầu tiên cần làm là lập tức liên hệ với tổng đài ngân hàng để tạm khóa các dịch vụ tài chính trực tuyến. Việc chủ động cập nhật các thủ đoạn công nghệ mới và chia sẻ cho người thân, đặc biệt là người già và trẻ em, sẽ giúp xây dựng một mạng lưới phòng thủ tâm lý hiệu quả trước những kịch bản lừa đảo ngày càng tinh vi của tội phạm AI.

Thời báo VTV cũng đăng tải bài viết với tiêu đề "Cảnh báo 4 hình thức lừa đảo xác thực sinh trắc học khuôn mặt". Nội dung như sau:

Theo Bộ Công an, 5 tháng đầu năm nay, thiệt hại do tội phạm lừa đảo chiếm đoạt tài sản đã lên tới hơn 4.000 tỷ đồng, tức là bằng 94% so với cả năm 2023.

Để ngăn chặn việc lừa đảo, Ngân hàng Nhà Nước quy định, từ ngày 1/7/2024, các giao dịch trên 10 triệu đồng phải được xác thực bằng sinh trắc học khuôn mặt. Việc xác thực này giúp truy vết và ngăn chặn các dòng tiền lừa đảo, dòng tiền vi phạm pháp luật như: cờ bạc online, rửa tiền … Nhưng ngay khi quy định có hiệu lực, đã có 4 hình thức lừa đảo hỗ trợ cập nhật sinh trắc học bùng phát:

Kẻ xấu đã mạo danh cán bộ ngân hàng, liên hệ với nạn nhân bằng các hình thức như gọi điện, nhắn tin, kết bạn qua các mạng xã hội như Zalo, Facebook... để hướng dẫn, thu thập thông tin sinh trắc học.

Một số đối tượng có thể lập nick gây nhầm lẫn như nhân viên ngân hàng, giả mạo hỗ trợ khách hàng, trà trộn tương tác với những bình luận của khách hàng dưới bài đăng trên mạng xã hội chính thức của ngân hàng để đề nghị khách hàng liên hệ riêng.

Trong nhiều trường hợp, kẻ xấu yêu cầu khách hàng cung cấp thông tin cá nhân, thông tin tài khoản ngân hàng, hình ảnh căn cước công dân, hình ảnh khuôn mặt, thậm chí cả giọng nói và cử chỉ của khách hàng để được hỗ trợ. Khi có được thông tin và tài khoản của người dùng, đối tượng xấu dễ dàng đăng nhập vào tài khoản và đánh cắp toàn bộ tiền của nạn nhân.

Kẻ xấu cũng có thể đề nghị người dùng truy cập vào đường link giả mạo do chúng tạo ra để tải và cài đặt ứng dụng thu thập sinh trắc học nhưng thực chất là tải về file có chứa mã độc, phần mềm gián điệp nhằm khai thác sâu hơn nữa những thông tin của nạn nhân.

Theo Bộ Công an, ngay khi Việt Nam triển khai chính sách mới, sự kiện mới, một số đối tượng ở nước ngoài đã liên hệ với các cá nhân ở Việt Nam để nhanh chóng triển khai phương thức lừa đảo, giả danh nhân viên ngân hàng thực hiện hỗ trợ cập nhật sinh trắc học cho người dân.

Bộ Công an đã phát hiện có những nhóm lừa đảo hàng trăm đối tượng, hoạt động chuyên nghiệp như một nghề để kiếm sống, chỉ chuyên dành thời gian nghiên cứu các chính sách vừa mới ra đời và từ đó nhanh chóng cho ra đời các kịch bản lừa đảo.

Việc cập nhật sinh trắc học khuôn mặt để chuyển khoản tiền nhưng đối tượng lừa đảo giờ đã có thể dùng cả ảnh chụp của nạn nhân được tạo nên từ công nghệ trí tuệ nhân tạo (AI) để lừa đảo. Vậy ông có thể phân tích thêm về thủ đoạn này và cách phòng tránh bị trở thành nạn nhân.

Theo ông Vũ Ngọc Sơn từ Hiệp hội An ninh mạng quốc gia, xác thực sinh trắc học là giải pháp tốt nhưng còn nguy cơ các đối tượng lừa đảo thuê người lập tài khoản và thuê chính những người này thực hiện việc chuyển tiền cho chúng. Do đó, người dùng cần đặc biệt cảnh giác, không tiếp tay cho đối tượng lừa đảo.