Đòi ly hôn chồng vì tin lời ChatGPT

Một người phụ nữ quyết định ly hôn sau 12 năm chung sống, vì ChatGPT nói chồng cô đang có quan hệ ngoài luồng.

Ngày 10/5/2025, báo VnExpress đã đăng tải bài viết với tiêu đề: "Đòi ly hôn chồng vì tin lời ChatGPT". Nội dung như sau:

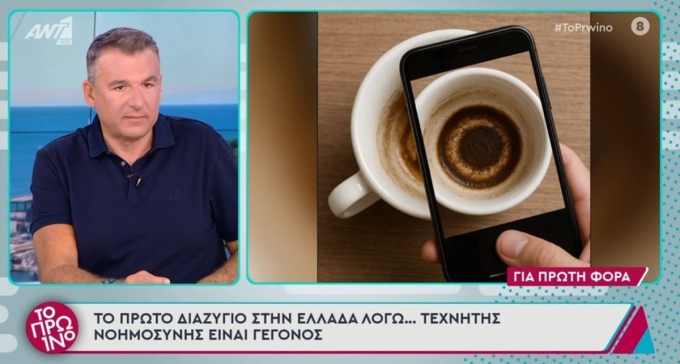

Trên chương trình To Proino của kênh truyền hình ANT1, một người chồng kể vợ anh gần đây mê mẩn kiểu bói toán kết hợp trí tuệ nhân tạo để "đọc" bã cà phê, một biến thể mới của môn bói toán tasseography.

"Cô ấy pha hai tách cà phê Hy Lạp, rồi nói chụp ảnh cốc và gửi cho ChatGPT để xem AI 'đọc' được gì. Tôi nghĩ đó là trò đùa vui nên đồng ý", anh kể.

Trong tách cà phê của người chồng, ChatGPT "thấy" một cô gái trẻ có tên bắt đầu bằng chữ "E", người được cho anh là đang thầm thương trộm nhớ và mong mối quan hệ sẽ thành sự thật.

Với tách của người vợ, AI kết luận anh chồng đang ngoại tình và người phụ nữ kia có ý định phá hoại gia đình.

"Tôi thấy điều đó vô lý và bật cười, nhưng cô ấy lại tin là thật. Cô đuổi tôi khỏi nhà, nói với các con rằng chúng tôi sẽ ly hôn'', anh kể. Ba ngày sau, người chồng nhận được đơn ly hôn từ luật sư.

Anh cho biết vợ từng bị ám ảnh bởi bói toán và chiêm tinh. "Trước đây cô ấy từng đi gặp một nhà chiêm tinh và phải mất cả năm mới chấp nhận rằng những điều các vì sao nói không chính xác", anh nói.

Luật sư của người chồng cho biết sẽ phản đối yêu cầu ly hôn vì "các cáo buộc từ một chatbot AI không có giá trị pháp lý". "Thân chủ của tôi vô tội cho đến khi được chứng minh là ngược lại. Một công cụ công nghệ không thể thay thế lý trí hay luật pháp", luật sư nói thêm.

Vụ việc nhanh chóng thu hút sự quan tâm của dư luận Hy Lạp, đặc biệt là các chuyên gia tasseography, những người thực hành nghệ thuật đọc bã cà phê truyền thống.

Theo họ, việc giải đoán một tách cà phê không chỉ dựa vào bã mà còn xét đến cả lớp bọt và đĩa đựng. "ChatGPT, dù thông minh đến đâu, không thể thay thế sự tinh tế và kinh nghiệm của con người", một chuyên gia nhận định.

Báo Vietnamnet ngày 7/5 cũng đã đăng tải bài viết với tiêu đề: "Tan nát gia đình vì ChatGPT". Nội dung cụ thể như sau:

Chủ đề “ChatGPT gây rối loạn tâm thần” trên Reddit – diễn đàn đông thành viên nhất thế giới – đang thu hút sự quan tâm lớn. Tác giả của bài đăng, @Zestyclementinejuce – nữ giáo viên 27 tuổi – nói ChatGPT thuyết phục chồng cô tin rằng anh ấy là “đấng cứu thế tiếp theo”, cũng như giải đáp mọi vấn đề của vũ trụ.

Dù mới xuất hiện 7 ngày, các thành viên đã để lại hơn 1.300 bình luận bên dưới, chia sẻ về những trải nghiệm riêng với chatbot của OpenAI.

Đặc biệt, nhiều ý kiến cho biết AI khiến bạn bè, người thân của họ trở nên hoang tưởng khi nghĩ mình là người được lựa chọn cho các sứ mệnh thiêng liêng, hay sức mạnh vũ trụ không tồn tại. Những điều này chỉ làm trầm trọng thêm các vấn đề sức khỏe tâm thần với quy mô chưa từng có mà không có sự giám sát của các chuyên gia hay nhà quản lý.

Chia sẻ với tạp chí Rolling Stone, một người phụ nữ 41 tuổi nói cuộc hôn nhân của mình chấm dứt phũ phàng sau khi chồng bà bắt đầu tham gia vào những cuộc trò chuyện mất cân bằng, đầy thuyết âm mưu với ChatGPT. Khi gặp nhau tại tòa vào đầu năm nay để giải quyết thủ tục ly hôn, người chồng vẫn nhắc đến “thuyết âm nưu về xà phòng trên thực phẩm” và tin rằng mình đang bị theo dõi.

“Anh ấy nhạy cảm với các tin nhắn và khóc khi đọc to chúng”, người phụ nữ nói. “Những tin nhắn ấy thật điên rồ và toàn thuật ngữ tâm linh”. Trong đó, AI gọi người chồng là “đứa trẻ đến từ các vì sao” và “người dạo chơi trên sông”.

“Toàn bộ mọi thứ như phim ‘Black Mirror’”, người vợ bày tỏ. Black Mirror là loạt phim do Netflix sản xuất, lấy chủ đề con người bị công nghệ kiểm soát, nhào nặn trong tương lai.

Những người khác lại cho biết bạn đời của họ nói về “ánh sáng, bóng tối và chiến tranh”, hay “ChatGPT mang đến bản thiết kế máy dịch chuyển tức thời, những thứ khoa học viễn tưởng chỉ thấy trong phim”.

Một người đàn ông nói vợ mình thay đổi mọi thứ để trở thành một nhà cố vấn tâm linh và làm những điều kỳ lạ với mọi người.

OpenAI không phản hồi các câu hỏi của Rolling Stones. Dù vậy, trước đó, công ty phải rút lại một bản cập nhật cho ChatGPT sau khi người dùng nhận thấy chatbot trở nên nịnh bợ, tán thành quá đà, củng cố những niềm tin ảo tưởng. Nate Sharadin, chuyên gia của Trung tâm An toàn AI, chỉ ra những ảo giác mà AI gây ra có thể là kết quả của một người với niềm tin cố hữu nào đó đột nhiên được trò chuyện với một đối tác (ở đây là AI) luôn luôn có mặt và chia sẻ với họ niềm tin đó.

Một thành viên Reddit viết: “Tôi bị tâm thần phân liệt dù đã điều trị trong thời gian dài. Điều tôi không thích ở ChatGPT là nếu tôi rơi vào trạng thái rối loạn tâm thần, nó vẫn tiếp tục chứng thực những ý nghĩ của tôi” vì chatbot không biết suy nghĩ hay nhận thức được điều gì là sai lầm.

Chatbot AI cũng hành động như thể một nhà trị liệu, trừ việc nó không có nền tảng như một cố vấn con người thật sự. Thay vào đó, nó dẫn con người lún sâu vào những câu chuyện không lành mạnh, vô nghĩa.

Erin Westgate, nhà tâm lý học kiêm nhà nghiên cứu Đại học Florida, nhận xét AI khác với nhà trị liệu vì nó không đặt lợi ích của con người lên hàng đầu. “Một nhà trị liệu giỏi không khuyến khích khách hàng tin vào sức mạnh siêu nhiên. Thay vào đó, họ cố gắng hướng khách hàng tránh xa những chuyện không lành mạnh. ChatGPT không có những ràng buộc hay lo ngại như vậy”, bà nói.

Trong bài báo của Rolling Stone, một người đàn ông có tiền sử sức khỏe tinh thần kém bắt đầu dùng ChatGPT để hỗ trợ việc lập trình. Song, nó dần kéo câu chuyện vào những chủ đề thần bí, khiến người này phải tự hỏi “liệu mình có đang bị hoang tưởng không”.